首先Lua中不存在byte[]类型,但又不属于userdata,所有的byte[]在lua中的数据类型为string (可以使用type(data)打印出来看),但是在实际使用的过程中和真正的string还是有一些区别 今天在项目中想将服务器转过来的protobuff数据序列化到本地,模拟服务器发消息,简化调试,结果确在序列化与反序列化的时候遇到了一个问题,那就是当 local data = msg:SerializeToString() 之后把作为“字符串”的data写成…

[LuaInterface.NoToLua]static public bool Raycast (Vector3 inPos) { for (int i = 0; i < list.size; ++i) { UICamera cam = list.buffer[i]; // Skip inactive scripts if (!cam.enabled || !NGUITools.GetActive(cam.gameObject)) continue; // Convert to view space cur…

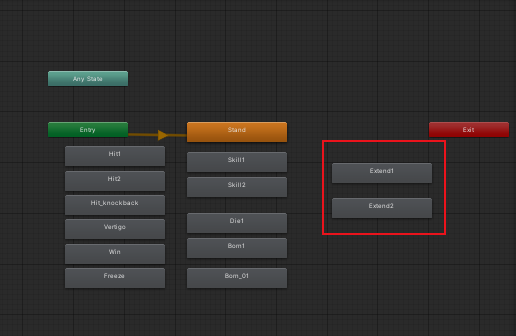

最近发现一个动作播放的细节问题,策划在技能编辑器中配置了在极短的时间中连续造成伤害的技能,间隔时间比受击动作时间还要短,这就意味着播放同一个动作(受击)时,需要打断之前的播放,注意,我这里说的是同一个动作的打断,并不是同一个动作的播放 经测试,在Animator中同一个状态在播放过程中无法再次播放自己,只有切到其他状态,再切回来这一个方法,但显然这样会导致结果并不是我们想要的,那么如果将两个状态设置成一样动作,然后在这两个状态之间来回切换呢?答案是可以的 于是这里又出现另一个问题,项目已经到后期了,让美术同学把每个…

游戏中的界面往往会添加一些动效来丰富玩家体验,前段时间我使用后期做了一个界面过渡的小功能,原理并不复杂,不过在刚接收需求的时候思路上也走了一些歪路,先看最终效果: 这个效果其实挺常见的,就是一个遮罩动画,相信大家分分钟就能把shader写出来,然而相我写完之后准备用到项目的时候,我发现了一个问题,我们的项目是使用NGUI做的(UGUI也有这个问题),游戏中的界面是由很多图片拼起来的,并不是一张图,而这个效果只能用于一张图片,此时我第一个想到的就是NGUI中UIPanel的SoftClip功能,众所周知,SoftCl…

前两天用后处理写了一个界面打开效果,结果在手机上显示黑屏,郁闷上的日志上并没有报错,在Unity中,可以方便的使用FrameDebug进行调试,如下图 可以使用Click+鼠标左键点开缩略图,查看对shader的赋值是否正确。 然而在手上,连接真机调试却是这样: 没有办法看到输入的纹理是否是正确的,所以第一想法就是把纹理输出的屏幕上,然后打真机进行调试,仔细观察FrameDebug的渲染顺序(如下图),发现UGUI.RenderOverlays在URP的最后渲染,也就是说我的截图操作在UGUI的RenderOver…

原来在BuildIn中修改RenderTarget很容易,它可以让我们用额外的相机照画面进行后处理再贴到指定的对象上,比如镜子,湖面,但是最近项目用了URP后渲染管线变了,问了同事后才知道需要单独接管额外相机的渲染,整理后代码如下: using System.Collections; using System.Collections.Generic; using UnityEngine; using UnityEngine.Rendering; using UnityEngine.Rendering.Univers…

fixed4 col = tex2D(_MainTex, i.uv); 亮度 _Brightness //亮度直接叠加 fixed3 color = col.rgb*_Brightness; 饱和度 _Saturation //饱和度=最低灰度颜色与原图的差值 fixed3 gray = fixed3(0.2125, 0.7154, 0.0721); fixed minGray = dot(gray, col.rgb); fixed3 grayColor = fixed3(minGray, minGray…

实现原理 1.先用一个Pass将原来的物体沿着该物体的顶点法线外移,使它变得比之前大 2.使用Outline的颜色填充整个物体,并且剔除正面的渲染,得到一个放大的背面 3.用第二个Pass正常渲染渲染,第二次正常渲染会挡住第一个渲染的背面,但是第一个Pass变大导致部分挡不住,则挡不住的那部分就变成了该物体的外描边 代码图如: //法线外扩实现法 Shader "Custom/Outline" { Properties { _MainTex("MainTex", 2D) = "white" {} _Outline(…